كشف باحثو الأمن السيبراني عن ثغرة بالغة الخطورة في منصة LeRobot مفتوحة المصدر التابعة لـ Hugging Face، والتي تحظى بشعبية واسعة على GitHub بما يقارب 24 ألف نجمة. الثغرة المسجلة تحت الرمز CVE-2026-25874 وبدرجة خطورة 9.3 وفق مقياس CVSS، ترتبط بعملية إلغاء تسلسل بيانات غير موثوقة باستخدام صيغة pickle غير الآمنة.

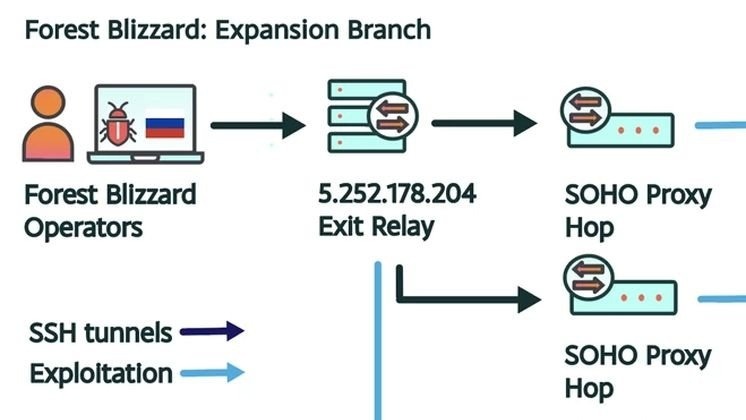

وفقًا للإشعار المنشور على GitHub، فإن المشكلة تكمن في خط أنابيب الاستدلال غير المتزامن، حيث يتم استخدام لمعالجة بيانات تصل عبر قنوات gRPC غير موثقة ودون تشفير TLS، وذلك في مكونات PolicyServer وrobot client. هذا يتيح للمهاجم إرسال حمولة خبيثة مصممة خصيصًا تمكنه من تنفيذ أوامر نظام تشغيل على الخادم أو العميل.

خطورة الاستغلال وتأثيراته المحتملة

شركة Resecurity أوضحت أن الخطر يكمن في أن خدمة PolicyServer مصممة لأنظمة الاستدلال الخاصة بالذكاء الاصطناعي، والتي غالبًا ما تعمل بامتيازات مرتفعة للوصول إلى الشبكات الداخلية والبيانات الحساسة والموارد الحاسوبية المكلفة. استغلال هذه الثغرة قد يؤدي إلى:

- تنفيذ أوامر عن بُعد دون مصادقة

- السيطرة الكاملة على الخادم المستضيف لـ PolicyServer

- التأثير على الروبوتات المتصلة بالنظام

- سرقة بيانات حساسة مثل مفاتيح API وبيانات اعتماد SSH وملفات النماذج

- التحرك الجانبي داخل الشبكة للوصول إلى أنظمة أخرى

- تعطيل الخدمات أو إفساد النماذج أو حتى التسبب في مخاطر جسدية عبر تخريب العمليات

اكتشاف الثغرة وتاريخها

الباحث الأمني فالنتين لوبستين من فريق VulnCheck هو من اكتشف الثغرة ونشر تفاصيلها الأسبوع الماضي، مؤكداً نجاح التحقق منها على الإصدار 0.4.3 من LeRobot. حتى الآن لم يتم إصدار إصلاح رسمي، لكن الفريق أعلن أن التحديث القادم 0.6.0 سيتضمن معالجة لهذه المشكلة.

اللافت أن الثغرة كانت قد أُبلغ عنها بشكل مستقل في ديسمبر 2025 من قبل الباحث المعروف باسم “chenpinji”، وقد اعترف فريق LeRobot بالمشكلة في يناير 2026، مشيرًا إلى أن جزءًا كبيرًا من الشيفرة يحتاج إلى إعادة كتابة كاملة نظرًا لطبيعة التنفيذ التجريبية السابقة.

مفارقة استخدام pickle في مشروع Hugging Face

المفارقة التي أشار إليها لوبستين تكمن في أن Hugging Face نفسها كانت قد طورت صيغة Safetensors لتجنب مخاطر pickle في بيانات تعلم الآلة، ومع ذلك فإن إطارها الروبوتي LeRobot ما زال يعتمد على لمعالجة مدخلات الشبكة التي يمكن أن يسيطر عليها المهاجم. الأسوأ أن الكود يحتوي على تعليقات # nosec لتعطيل التحذيرات الأمنية، وهو ما يفتح الباب أمام استغلال مباشر وخطير.

هذا يكشف مرة أخرى عن خطورة الاعتماد على pickle في مشاريع الذكاء الاصطناعي، حيث يمكن لملف مُصمم بعناية أن يؤدي إلى تنفيذ أوامر عشوائية بمجرد تحميله، وهو ما يجعل هذه الثغرة من أخطر التحديات التي تواجه مجتمع المصادر المفتوحة في مجال الروبوتات والذكاء الاصطناعي.