مع تزايد اعتماد المؤسسات على المساعدين الرقميين والـ”كو بايلوت”، ما زالت فرق الأمن تركز على حماية النماذج نفسها. لكن الحوادث الأخيرة تكشف أن الخطر الأكبر يكمن في سير العمل الذي يحيط بهذه النماذج. فقد تم ضبط إضافتين لمتصفح كروم تتظاهر بأنها أدوات ذكاء اصطناعي، بينما كانت تسرق بيانات محادثات ChatGPT وDeepSeek من أكثر من 900 ألف مستخدم. وفي حادثة أخرى، أظهر الباحثون كيف يمكن لحقن أوامر خبيثة داخل مستودعات الأكواد أن تدفع مساعد IBM البرمجي إلى تنفيذ برمجيات ضارة على جهاز المطور. اللافت أن أيّاً من هذه الهجمات لم يخترق خوارزميات الذكاء الاصطناعي نفسها، بل استغل البيئة التي تعمل فيها.

الذكاء الاصطناعي يتحول إلى محرك سير عمل

الاستخدامات اليومية للذكاء الاصطناعي تكشف حجم المخاطر الجديدة. فمساعد الكتابة قد يستدعي مستنداً سرياً من SharePoint ويحوّله إلى مسودة بريد إلكتروني، أو قد يقوم روبوت مبيعات بمراجعة سجلات CRM الداخلية للإجابة عن استفسار عميل. هذه السيناريوهات تخلق مسارات تكامل جديدة بين التطبيقات بشكل فوري، ما يوسع سطح الهجوم ليشمل كل مدخل ومخرج ونقطة تكامل يلمسها النموذج.

الخطورة تكمن في أن الذكاء الاصطناعي يعتمد على قرارات احتمالية لا على قواعد صارمة، ما يجعله عرضة للتلاعب عبر مدخلات مصاغة بعناية. هكذا يمكن للمهاجم أن يوجّه النموذج لتنفيذ ما لم يكن مقصوداً أصلاً، دون الحاجة لاختراق الكود.

لماذا تفشل الضوابط التقليدية؟

التهديدات المرتبطة بسير العمل تكشف ثغرة في الدفاعات التقليدية التي بُنيت لبرمجيات حتمية ذات أدوار ثابتة وحدود واضحة. أما في بيئة الذكاء الاصطناعي:

- كل شيء يُقرأ كنص، ما يجعل التعليمات الخبيثة في ملف PDF تبدو طبيعية.

- مراقبة الأنماط التقليدية لا تكشف نشاطاً غير اعتيادي، مثل قراءة آلاف السجلات ضمن استعلام روتيني.

- السياسات الأمنية القائمة على السماح والمنع تفشل أمام سلوك يعتمد على السياق.

- المراجعات الدورية لا تواكب ديناميكية سير العمل، حيث قد يتغير التكامل أو تُضاف مصادر بيانات جديدة قبل أي مراجعة.

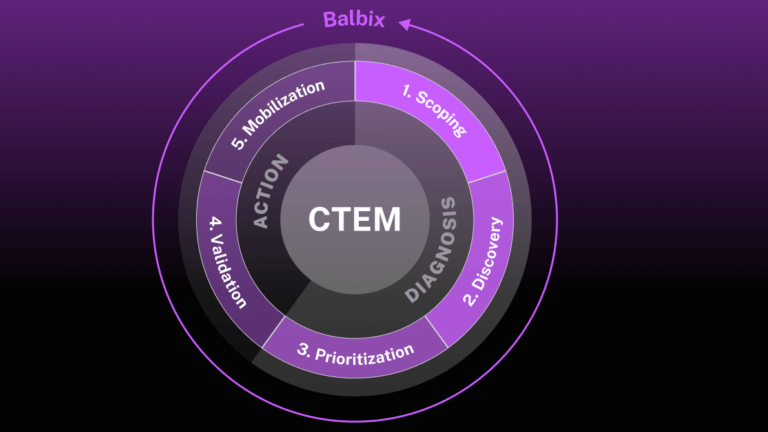

نحو أمن سير العمل المدعوم بالذكاء الاصطناعي

الحل يكمن في حماية سير العمل بأكمله لا النموذج فقط. على المؤسسات أن تبدأ بتحديد أين يُستخدم الذكاء الاصطناعي فعلياً، سواء عبر أدوات رسمية مثل Microsoft 365 Copilot أو إضافات غير معتمدة. يجب ضبط صلاحيات الوصول بدقة، ومراقبة المخرجات قبل مغادرة البيئة الداخلية، وتقييد الأذونات عبر رموز OAuth بحيث لا يحصل المساعد إلا على ما يحتاجه فعلاً.

كما أن التوعية ضرورية: على الموظفين إدراك مخاطر الإضافات غير الموثوقة أو نسخ الأوامر من مصادر مجهولة. كل أداة تتعامل مع مدخلات أو مخرجات الذكاء الاصطناعي يجب اعتبارها جزءاً من محيط الأمن.

منصات ديناميكية لحماية سير العمل

تنفيذ هذه الإجراءات يدوياً لا يمكن أن يتوسع مع حجم المؤسسات، وهنا تظهر فئة جديدة من الأدوات: منصات أمن SaaS ديناميكية. هذه المنصات تعمل كطبقة حراسة فورية فوق سير العمل المدعوم بالذكاء الاصطناعي، تتعلم السلوك الطبيعي وتكشف الانحرافات في الوقت الحقيقي.

منصة Reco مثال بارز، إذ تمنح فرق الأمن رؤية شاملة لاستخدامات الذكاء الاصطناعي داخل المؤسسة، وتحدد التطبيقات المتصلة وكيفية تفاعلها. ومن هناك يمكن فرض ضوابط على مستوى سير العمل، ورصد السلوكيات الخطرة فور وقوعها، والحفاظ على السيطرة دون تعطيل سير الأعمال.