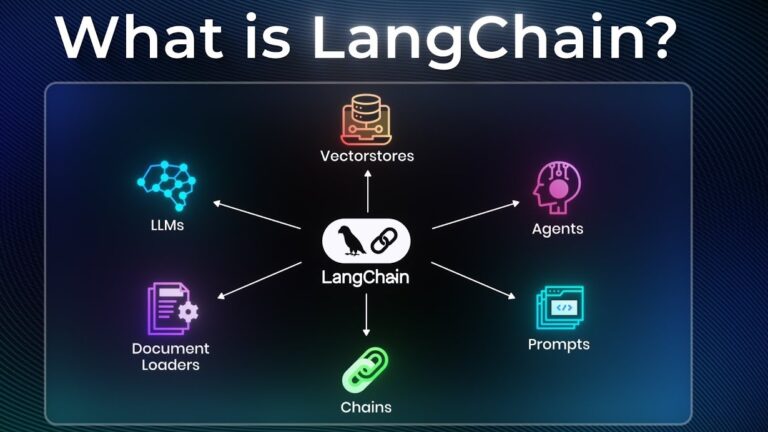

كشف باحثون في مجال الأمن السيبراني عن تفاصيل هجوم جديد على سلسلة التوريد أُطلق عليه اسم “باب خلفي لملف القواعد” (Rules File Backdoor)، يستهدف محررات الأكواد المدعومة بالذكاء الاصطناعي مثل GitHub Copilot وCursor، مما يمكّن المهاجمين من حقن أكواد خبيثة في المشاريع البرمجية.

استغلال مخفي داخل الذكاء الاصطناعي

أوضح زيف كارلينر، الشريك المؤسس والرئيس التقني لشركة Pillar Security، في تقرير تقني نشره موقع The Hacker News:

“تسمح هذه التقنية للهاكرز باختراق الكود الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي بصمت، من خلال حقن تعليمات خبيثة مخفية داخل ملفات التكوين (Configuration Files) التي تبدو بريئة، والمستخدمة في كل من Cursor وGitHub Copilot.“

وأشار إلى أن المهاجمين يستغلون الحروف غير المرئية والتقنيات المتقدمة لتجاوز الفحوصات الأمنية المعتادة، مما يجعل الكود الضار قادرًا على تجاوز مراجعات الأمان التقليدية.

خطر واسع على سلسلة التوريد البرمجية

يُعد هذا الهجوم خطيرًا لأنه يسمح بانتشار الأكواد الخبيثة بصمت عبر المشاريع المختلفة، مما يشكل تهديدًا لسلسلة التوريد البرمجية.

ويتمثل جوهر الهجوم في التلاعب بملفات القواعد التي تستخدمها الأدوات القائمة على الذكاء الاصطناعي لتوجيه سلوكها، حيث يعتمد على تضمين مطالبات مصممة بعناية داخل ملفات القواعد، مما يدفع الذكاء الاصطناعي إلى توليد أكواد تحتوي على ثغرات أمنية أو أبواب خلفية.

كيف يتم تنفيذ الهجوم؟

يمكن تنفيذ هذا الهجوم عبر:

- استخدام أحرف غير مرئية مثل Zero-Width Joiners وBidirectional Text Markers لإخفاء التعليمات الخبيثة داخل ملفات القواعد.

- استغلال تفسير الذكاء الاصطناعي للغة الطبيعية لتوليد أكواد ضعيفة أمنيًا، عن طريق خداع النموذج الذكي لتجاوز قيود الأمان والأخلاقيات المدمجة.

مايكروسوفت وCursor تتنصلان من المسؤولية

بعد الكشف المسؤول عن الثغرة في فبراير ومارس 2024، صرّحت كل من GitHub وCursor بأن المستخدمين هم المسؤولون عن مراجعة وقبول الاقتراحات التي يتم إنشاؤها بواسطة الأدوات.

لكن كارلينر حذّر قائلًا:

“يمثل هجوم ‘باب خلفي لملف القواعد’ خطرًا كبيرًا لأنه يستغل الذكاء الاصطناعي نفسه كوسيلة للهجوم، مما يحول المساعد البرمجي الأكثر ثقة للمطورين إلى شريك غير مقصود في الهجمات، مما قد يؤثر على ملايين المستخدمين النهائيين عبر البرمجيات المخترقة.“

خطر دائم عبر المستودعات البرمجية

بمجرد أن يتم إدراج ملف قواعد مُسمم في مستودع مشروع برمجي، فإنه:

✅ يؤثر على جميع جلسات إنشاء الأكواد المستقبلية للفريق.

✅ يظل نشطًا حتى في حالات تفرع المشروع (Forking)، مما يفتح الباب أمام هجمات سلسلة التوريد التي قد تؤثر على التبعيات البرمجية والمستخدمين النهائيين.

كيف تحمي مشاريعك من هذا الهجوم؟

🔹 مراجعة صارمة لجميع ملفات القواعد قبل استخدامها في مشاريع الذكاء الاصطناعي.

🔹 التحقق من عدم وجود أحرف مخفية أو تعليمات مشبوهة داخل ملفات التكوين.

🔹 استخدام أدوات كشف الأكواد الضارة لمراقبة أي نشاط مشبوه داخل المشاريع البرمجية.

ومن المعروف أن “هجوم باب خلفي لملف القواعد” يمثل تحديًا خطيرًا في مجال الأمن السيبراني، إذ يستغل التطورات الحديثة في الذكاء الاصطناعي لإحداث اختراقات غير مرئية داخل البرمجيات. ومع تزايد الاعتماد على مساعدي الذكاء الاصطناعي في البرمجة، يجب أن يكون المطورون أكثر وعيًا بمخاطر الهندسة الاجتماعية الرقمية والاستغلال الخفي للأدوات التي يعتمدون عليها يوميًا.